Het stille gevaar van automation bias

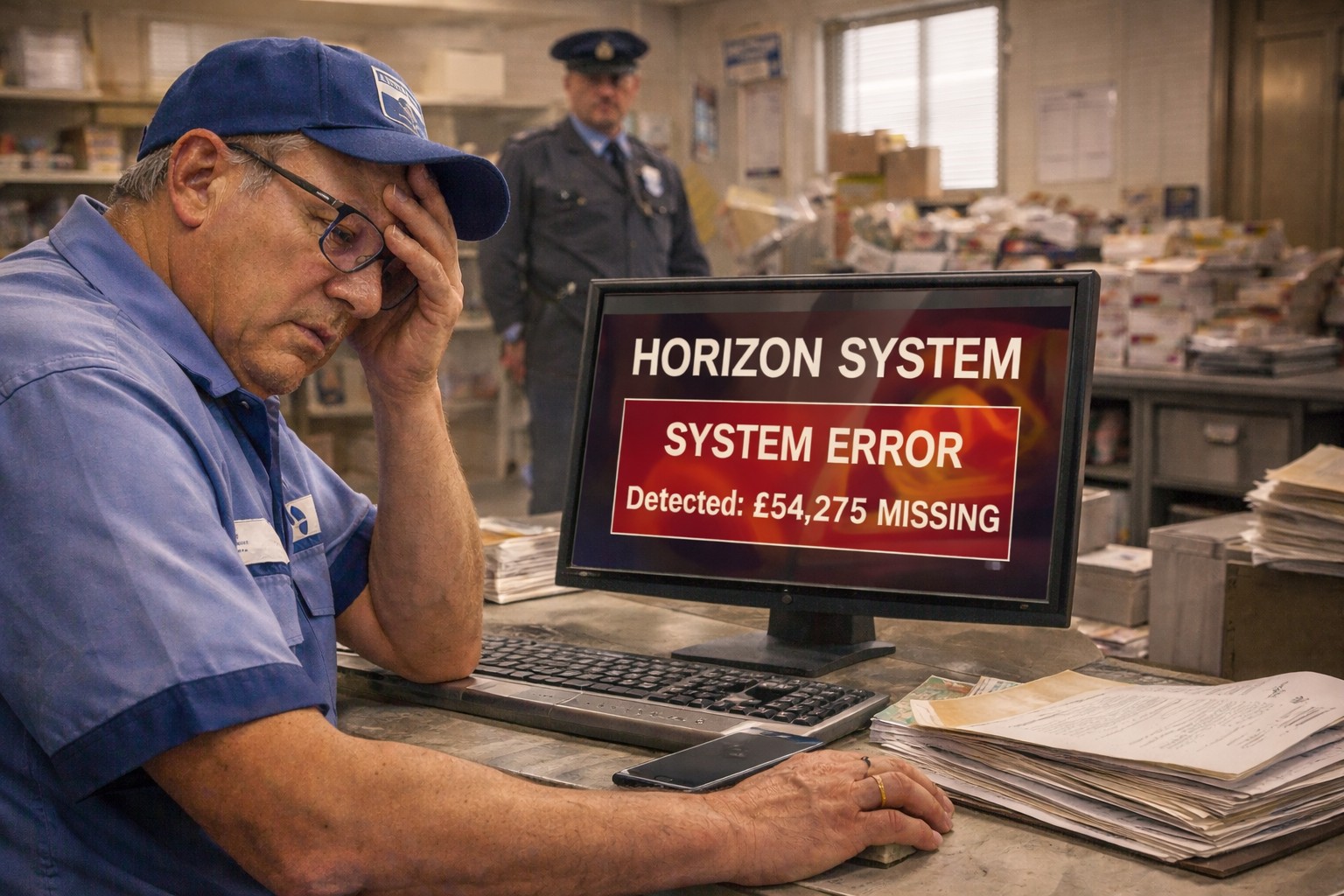

Ze werden beschuldigd van diefstal. Veroordeeld, gefailleerd, sommigen kwamen in de gevangenis terecht. Niet omdat ze iets hadden gedaan, maar omdat een computersysteem zei dat de cijfers niet klopten — en niemand dat systeem durfde te betwijfelen.

Het verhaal van de Britse postmeesters en het Horizon-systeem is inmiddels een van de bekendste schandalen in de geschiedenis van de automatisering. Maar het is ook iets anders: een les over wat er gebeurt als mensen te veel vertrouwen op de uitkomst van een machine.

Wat is er gebeurd?

Vanaf 1999 rolde de Britse Post Office een nieuw boekhoudpakket uit — Horizon geheten — in zo’n veertienduizend postkantoren. Het systeem registreerde inkomsten en uitgaven automatisch. Handiger, sneller, betrouwbaarder dan papier. Althans, zo luidde de belofte.

Maar Horizon bevatte fouten. Ernstige, structurele fouten die zorgden voor fictieve tekorten in de kasboeken van postmeesters door het hele land. Tekorten die er in werkelijkheid niet waren.

Wat volgde, is ronduit verbijsterend. Meer dan 700 postmeesters werden door de Post Office vervolgd voor diefstal en valsheid in geschrifte. De redenering was simpel: het systeem registreert een tekort, dus er moet iemand in de kas hebben gezeten. Interne waarschuwingen over softwarefouten werden genegeerd. Tegenbewijzen van de postmeesters zelf werden weggewuifd. Want het systeem had het gezegd. En een systeem liegt toch niet?

Een menselijke fout, geen computerprobleem

Wat dit schandaal zo leerzaam maakt, is dat de kern van het probleem niet technisch was. De softwarefouten waren reëel, maar de eigenlijke ramp ontstond daarna — in de hoofden van de mensen die het systeem moesten beoordelen.

Managers, juristen en rechters namen de uitkomsten van Horizon klakkeloos over. Niet omdat ze kwaadwillend waren, maar omdat een geautomatiseerd systeem nu eenmaal objectief lijkt. Cijfers liegen niet. Computers maken geen fouten. Wie durfde er te beweren dat de machine het bij het verkeerde eind had?

Dit is automation bias in zijn meest destructieve vorm. Niet de fout van het systeem, maar het blinde vertrouwen erin — het opzijzetten van eigen waarneming, vakkennis en het gezond verstand van honderden mensen die allemaal zeiden: “Maar ik heb niets gedaan.”

Dichter bij huis dan je denkt

Het Horizon-schandaal is extreem, maar automation bias is alledaags. Een recruiter die een AI-gegenereerde shortlist niet meer kritisch bekijkt, omdat het systeem die toch al heeft samengesteld. Een arts die een diagnose van een algoritme overneemt zonder de patiënt goed te onderzoeken. Een jurist die een AI-samenvatting van een dossier als compleet beschouwt. Een ambtenaar die een fraudesignaal van een algoritme omzet in een beslissing, zonder zelf te toetsen of de feiten kloppen.

In al deze gevallen speelt hetzelfde mechanisme: zodra een systeem een antwoord geeft, voelt verdere controle overbodig. Het model heeft het al gedaan. Waarom zou je het nog eens dunnetjes overdoen?

Juist omdat systemen het merendeel van de tijd goed presteren, daalt de waakzaamheid. En dat is precies het moment waarop automation bias het gevaarlijkst is.

Menselijk oordeel is geen zwakte

De ironie is dat automation bias zichzelf versterkt. Hoe meer mensen de uitkomst van een systeem overnemen zonder controle, hoe normaler dat gedrag wordt — en hoe groter de drempel wordt om ertegenin te gaan. De recruiter die de shortlist wél in twijfel trekt, blokkeert het proces. De postmeester die zegt dat de cijfers niet kloppen, wordt niet geloofd.

Maar menselijk oordeel is geen zwakte. Vakkennis, intuïtie, het gevoel dat iets niet klopt — dit zijn geen bijkomstigheden die een systeem overbodig maakt, maar noodzakelijke aanvullingen op wat een systeem kan. AI is een hulpmiddel, geen rechter.

De les van Horizon

De Britse overheid erkende het schandaal uiteindelijk in 2024. Veroordelingen werden teruggedraaid, compensatie betaald — maar de schade in mensenlevens valt niet terug te draaien. Vijfentwintig jaar na de invoering van Horizon staat vast wat al veel eerder duidelijk had kunnen zijn: het systeem klopte niet, en de mensen die dat zeiden hadden gelijk.

Automation bias is niet het gevolg van domheid of nalatigheid. Het is een menselijk patroon dat sterker wordt naarmate systemen complexer en alomtegenwoordiger worden. De vraag is niet of we AI moeten vertrouwen. De vraag is of we onszelf nog genoeg vertrouwen om te zeggen: wacht even, laat mij hier zelf naar kijken.

Automation bias beschrijft de neiging van mensen om blindelings te vertrouwen op de uitkomsten van geautomatiseerde systemen — ook als die uitkomsten onjuist zijn. Het zit niet in de machine, maar in de mens die hem gebruikt.

Leave a Reply to A WordPress Commenter Cancel reply