Hoe één juridische blunder (februari 2026) laat zien waarom mensen AI te snel geloven

Inleiding

Automatisering maakt werk sneller. AI maakt het nóg sneller. En precies daar ontstaat een nieuw menselijk risico:

automation bias — de neiging om de uitkomst van een systeem te volgen zonder voldoende kritische controle.

Dat klinkt theoretisch, tot je ziet wat er gebeurt als “AI als hulpmiddel” stilletjes verandert in “AI als waarheid”.

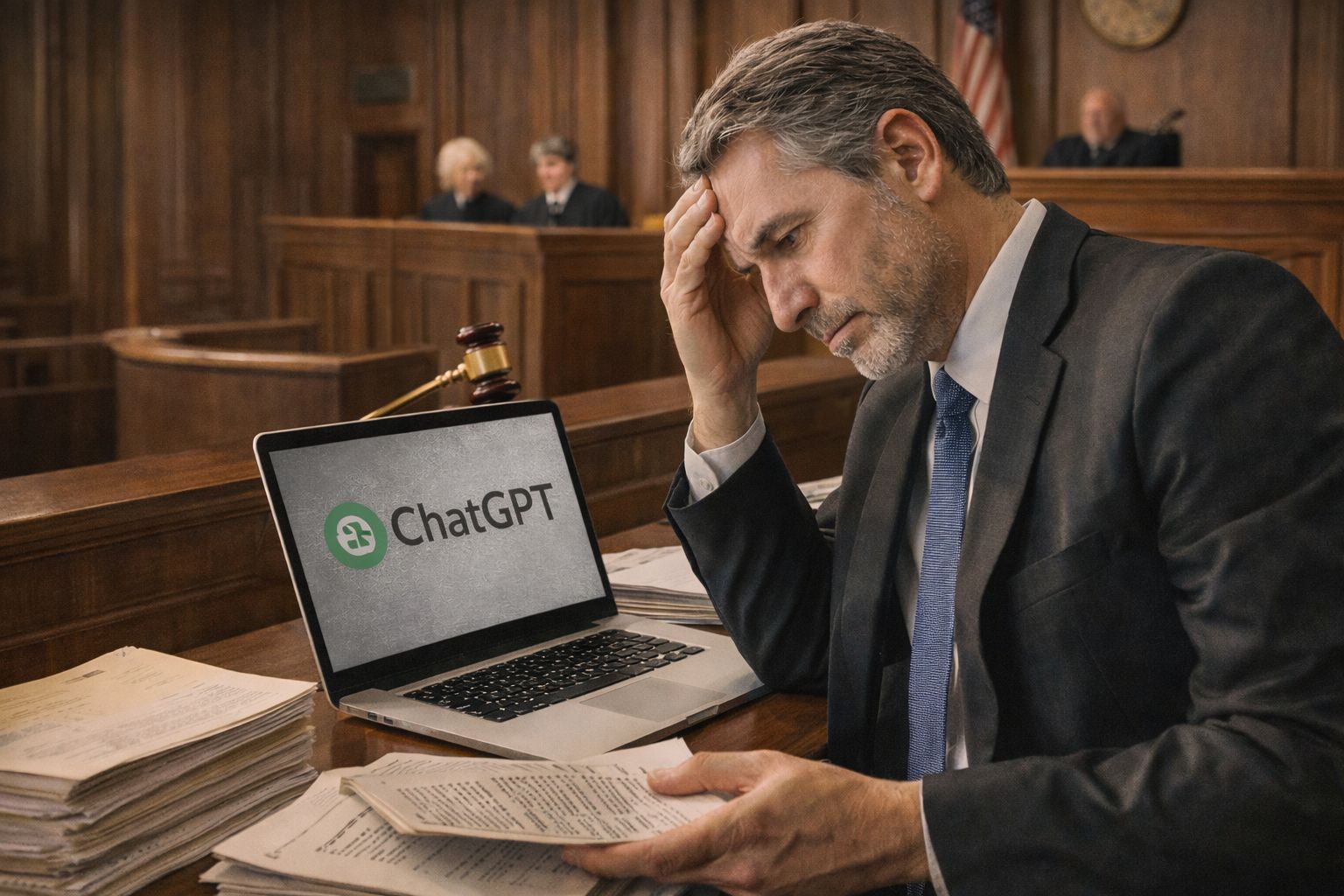

In februari 2026 legde een Amerikaans hof een boete op aan een advocaat nadat een ingediend stuk vol zat met verzonnen of

ernstig verdraaide verwijzingen, gekoppeld aan AI-gebruik.

Bron

Die case is interessant omdat het niet gaat over “slechte AI”, maar over menselijk gedrag rond AI.

Kern

1) Wat er precies misgaat bij automation bias

Automation bias heeft meestal twee gezichten:

- Klakkeloos overnemen (commission error): het systeem zegt iets, dus het zal wel kloppen.

- Niet meer zoeken naar wat ontbreekt (omission error): het systeem noemt iets niet, dus het zal wel niet relevant zijn.

In de juridische voorbeelden zie je beide: AI produceert ogenschijnlijk nette citaties en de menselijke controle verschuift van

“inhoud checken” naar “even scannen of het er professioneel uitziet”. Het resultaat: fouten gaan door de poort omdat het systeem

autoriteit uitstraalt (vloeiend, stellig, goed geformatteerd).

2) De actualiteit: waarom die rechtszaken zo’n goede illustratie zijn

De boete van februari 2026 kwam niet uit het niets. Er zijn de laatste tijd meerdere sancties opgelegd voor AI-gegenereerde

(en niet geverifieerde) citaties in rechtbankstukken.

Bron

Ook buiten de VS waarschuwen rechters expliciet voor het gebruik van AI bij het opstellen van juridische stukken na gevallen met

niet-bestaande uitspraken.

Bron

Dit zijn schoolvoorbeelden van automation bias: de AI is niet “de schuldige” op zichzelf; de fout ontstaat doordat een mens of team

de output behandelt alsof die al gecontroleerd is.

3) Waarom AI dit effect versterkt

Generatieve AI heeft drie eigenschappen die automation bias versnellen:

- Vloeiendheid = schijnzekerheid

Een antwoord dat goed geschreven is, voelt juist. Dat is precies de valkuil. - Snelheid verlaagt de drempel voor controle

Als iets in 10 seconden “af” is, voelt 10 minuten checken disproportioneel. - Autoriteitsbias stapelt zich op automation bias

Teams geven AI-output vaak onbewust het gewicht van een “tool” (dus: objectief), terwijl het in werkelijkheid een probabilistische generator is.

4) Wanneer het risico het grootst is

Automation bias neemt toe als:

- de taak tijdsdruk heeft (deadline, incident, drukke inbox),

- de gebruiker minder domeinkennis heeft,

- de AI meestal “goed genoeg” is (vertrouwen groeit langzaam, controles verdwijnen),

- de output in een professioneel format komt (citaties, tabellen, “officiële” toon).

5) Hoe organisaties automation bias praktisch beperken

Dit zijn ingrepen die in de praktijk het meest opleveren — zonder AI-voordeel weg te gooien:

- Maak “controle” een processtap, geen karaktereigenschap.

Bijvoorbeeld: “Elke feitelijke claim moet terug te leiden zijn naar een bron in de input/kennisbank.” (Niet: “Wees kritisch”.) - Zet “bewijs” boven “mooi antwoord”.

Laat systemen standaard werken met bronpassages, citaten, of interne verwijzingen naar eigen kennisblokken (zeker bij beleid, cijfers, claims). - Introduceer een tweede lezing voor high-stakes output.

Niet om te wantrouwen, maar om automation bias te doorbreken. In legal/finance/medisch: vier-ogen principe op feiten, niet op stijl. - Ontwerp de UI/flow tegen schijnzekerheid.

Laat onzekerheid en aannames expliciet zien. Vermijd “definitieve toon” als de bronbasis dun is. - Train teams op de twee failure modes.

Niet alleen “AI kan hallucineren”, maar:- “AI kan overtuigend fout zijn” (commission)

- “AI kan cruciale dingen weglaten” (omission)

Conclusie

Automation bias is geen “domme fout”, maar een menselijk patroon dat sterker wordt naarmate systemen sneller, vloeiender

en betrouwbaarder lijken. De recente juridische sancties maken dat tastbaar: de schade ontstaat niet omdat AI bestaat, maar omdat controle

verdwijnt zodra AI-output normaal wordt.

Bron

De oplossing is daarom ook niet “minder AI”, maar AI met ingebouwde controlemomenten: bewijs-gedreven workflows, duidelijke

checkregels en procesmatig terugleiden naar broninformatie. Dan blijft AI een versneller — zonder dat het stiekem de rol van waarheid

overneemt.