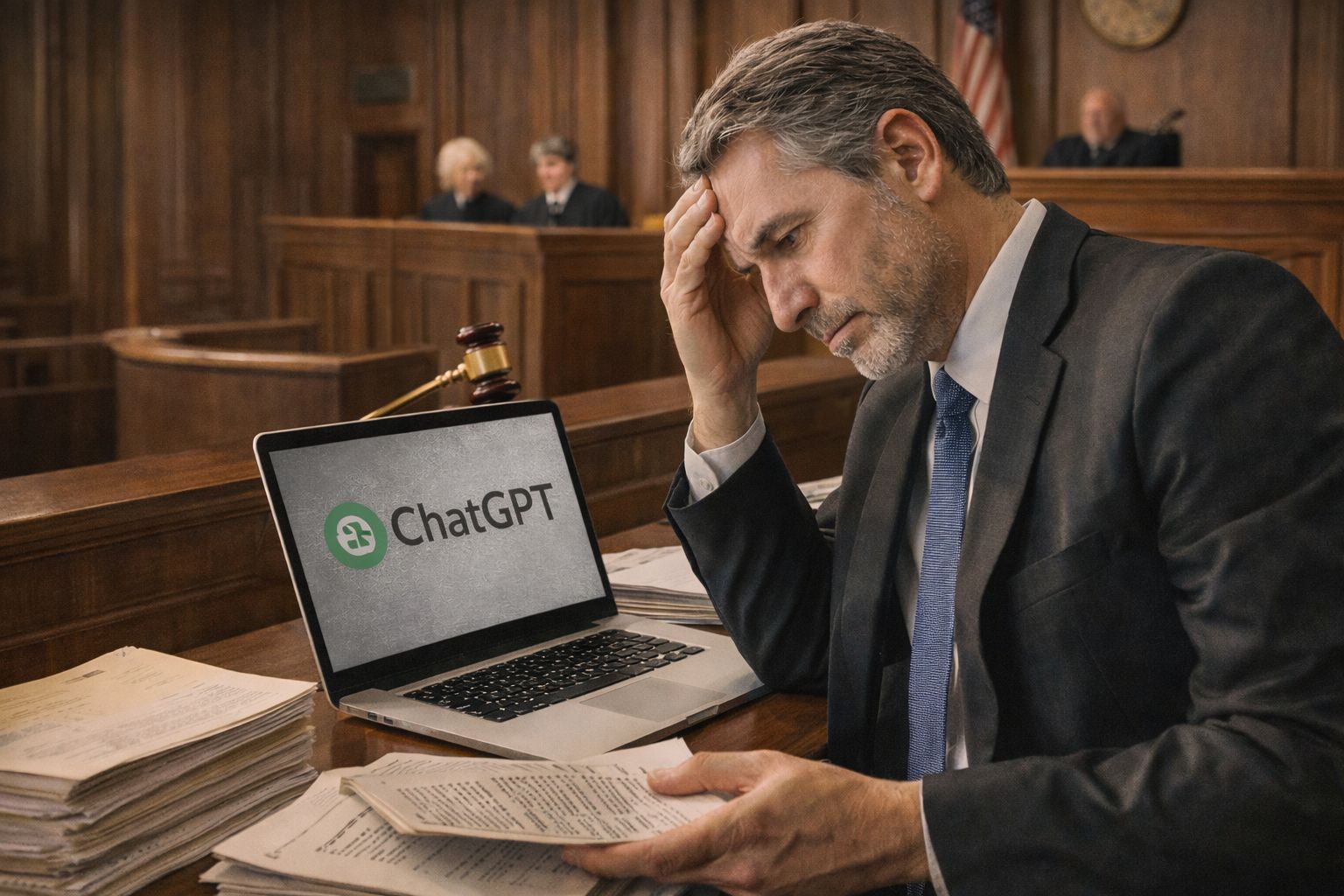

De jurist had haast. Een dossier moest af, de deadline naderde, en hij vroeg een AI-assistent om relevante jurisprudentie op te zoeken. Het systeem leverde: vijf uitspraken, met zaaknummers, rechters, data. Precies wat hij nodig had.

Hij verwerkte ze in zijn pleitnota. Stuurde die in. En ontdekte pas tijdens de zitting — toen de rechter vroeg naar de vindplaats van een specifieke uitspraak — dat drie van de vijf zaken nooit hadden bestaan. Het systeem had ze verzonnen. Zelfverzekerd, gedetailleerd, en volledig uit de lucht gegrepen.

Dit is geen hypothetisch scenario. In 2023 werd een Amerikaanse advocaat beboet omdat hij AI-gegenereerde, niet-bestaande rechterlijke uitspraken had ingediend. Het systeem had gelogen — en hij had het niet gecontroleerd.

Wat zijn AI-hallucinaties?

Taalmodellen genereren tekst door te voorspellen welk woord of welke zin het meest waarschijnlijk volgt op wat er al staat. Ze zijn niet verbonden met een database van feiten. Ze “weten” niets in de betekenis die wij daaraan geven. Ze produceren taal die plausibel klinkt — en plausibel is niet hetzelfde als waar.

Wanneer een taalmodel iets genereert dat feitelijk onjuist is, maar dat presenteert alsof het een vaststaand feit is, noemen we dat een hallucinatie. De term is wat misleidend — het klinkt als iets wat zelden voorkomt, bij uitzondering, in extreme gevallen. De realiteit is anders.

Hallucinaties zijn structureel. Ze zijn geen bugs die ontwikkelaars kunnen oplossen met een patch. Ze zijn een eigenschap van hoe taalmodellen werken. En ze zijn het gevaarlijkst als de output er het meest betrouwbaar uitziet.

Het probleem van zelfverzekerde onzin

Wat hallucinaties zo gevaarlijk maakt, is niet dat ze voorkomen — het is hoe ze worden gepresenteerd. Een AI die iets niet weet, zegt dat zelden. Het systeem aarzelt niet, voegt geen voorbehoud toe, geeft geen signaal dat de informatie onbetrouwbaar is. Het geeft gewoon een antwoord. Vloeiend, volledig, overtuigend.

Dat is het paradoxale probleem: hoe beter een taalmodel is in het produceren van coherente, goed geformuleerde tekst, hoe geloofwaardiger ook de fouten klinken. Een slecht systeem maakt fouten die opvallen. Een goed systeem maakt fouten die vertrouwen wekken.

Denk aan het verschil tussen een student die stuntelig antwoordt en duidelijk twijfelt, en een student die met groot zelfvertrouwen een verkeerd antwoord geeft. Welke twijfel je meer? De zelfverzekerde student is gevaarlijker — precies omdat het zelfvertrouwen signaleert dat er geen reden tot twijfel is.

Dichter bij huis dan je denkt

Niet elke hallucinatie leidt tot een rechtszaak. Maar de alledaagse varianten zijn net zo verraderlijk, juist omdat de gevolgen minder zichtbaar zijn.

Een marketeer vraagt een AI om statistieken over zijn branche. Het systeem geeft cijfers, met bronvermelding. De marketeer verwerkt ze in een rapport. De bronnen bestaan niet, of de cijfers kloppen niet — maar wie controleert dat nog?

Een journalist vraagt naar de achtergrond van een persoon. De AI beschrijft een carrière, vermeldt functies en organisaties. Sommige details zijn verzonnen. De journal